O recente episódio envolvendo uma notícia sobre Lady Gaga distribuindo pizzas, ilustrada por uma imagem convincente, porém totalmente gerada por Inteligência Artificial (IA), e a subsequente retratação de veículos como o InfoMoney, que republicou – sem checar – a notícia distribuída pela agência de notícias do jornal O Estado de S. Paulo, serve como um alerta de um desafio muito maior que bate à porta das corporações: o paradoxo da IA.

Se, por um lado, celebramos a capacidade da IA de otimizar processos, gerar insights a partir de dados complexos, personalizar experiências e acelerar entregas a níveis sem precedentes, por outro, confrontamos a mesma tecnologia como uma potencial usina de desinformação, capaz de criar narrativas e visuais falsos com realismo assustador.

Está estabelecido um dos maiores paradoxos da atualidade dentro da comunicação: ganhos x riscos. Por trás de toda esta história do calçadão de Copacabana, está a figura humana. Seja quem gerou – sabe-se lá com qual intuito, quem republicou sem checar e, obviamente, quem acreditou mesmo que a cantora saiu com caixas de pizzas distribuindo aos fãs, embaixo do sol do Rio de Janeiro.

Mas como controlar a disseminação em massa de inverdades geradas por IA?

A IA que analisa terabytes de dados para prever tendências de mercado é, em sua essência tecnológica, parente da IA que pode gerar um áudio deepfake do CEO anunciando uma decisão estratégica falsa, ou criar imagens “oficiais” de um produto inexistente. A mesma ferramenta que impulsiona a inovação pode ser usada para minar a confiança. Isto está bem longe daquele juramento que fazemos quando recebemos nosso diploma de jornalismo, por exemplo: o compromisso com a verdade, a ética e a imparcialidade. Controlar totalmente este movimento é, talvez, uma utopia na era da informação descentralizada. No entanto, as empresas podem e devem implementar barreiras e estratégias:

- Alfabetização em IA: promover o entendimento generalizado sobre como a IA funciona, suas capacidades e suas limitações. Isso inclui saber identificar potenciais sinais de conteúdo gerado artificialmente.

- Tecnologias de detecção: investir e utilizar ferramentas que ajudem a identificar conteúdo sintético (embora seja uma corrida constante, pois a IA generativa também evolui rapidamente).

- Políticas claras de uso: definir diretrizes rigorosas sobre como e quando ferramentas de IA podem ser usadas para criar ou disseminar informações, tanto interna quanto externamente.

- Verificação humana: manter processos robustos de checagem e validação humana, especialmente para informações críticas ou de alto impacto. A tecnologia auxilia, mas o discernimento humano (bem treinado) ainda é mais do que fundamental. Ou seja, o senso crítico do profissional curador de conteúdo nas corporações será cada vez mais apreciado – e fundamental.

Impactos nas empresas: Além da reputação

Importante ressaltar que a disseminação de desinformação gerada ou amplificada por IA pode ter consequências devastadoras para as empresas, entre elas, destaco algumas:

Danos à reputação e confiança: como no caso da notícia, a credibilidade pode ser rapidamente erodida. O mesmo pode ocorrer com as marcas.

Manipulação de mercado: notícias falsas sobre finanças ou lançamentos podem afetar o valor das ações.

Confusão interna e baixa moral: informações falsas circulando entre funcionários podem gerar insegurança, boatos e desconfiança na liderança e na corporação,d e forma geral.

Decisões de negócios baseadas em dados falsos: relatórios ou análises geradas por IA sem a devida validação podem levar a estratégias equivocadas. Olha o risco!

Riscos legais e de compliance: empresas podem ser responsabilizadas por informações falsas que disseminam, mesmo que inadvertidamente.

Liderança na Era da IA: treinamento e adaptação

A comunicação na Era da Inteligência Artificial impõe às lideranças um desafio multifacetado, que transcende a mera compreensão técnica para abarcar a delicada gestão de equipes, particularmente aquelas compostas por nativos digitais. A capacitação desses líderes, portanto, deve evoluir para além do domínio ferramental da IA, incorporando uma forte visão estratégica e um profundo senso ético que permita definir limites claros para seu uso. Isso envolve cultivar a habilidade de identificar e mitigar os riscos inerentes, notadamente a proliferação de desinformação, e praticar uma comunicação transparente sobre as políticas e aplicações da IA na organização.

O diálogo com os nativos digitais adiciona uma camada de complexidade: sua familiaridade intuitiva com a tecnologia coexiste, paradoxalmente, com uma potencial vulnerabilidade a conteúdos sintéticos visualmente apelativos ou interativos. Cabe à liderança, então, não apenas guiar, mas educar ativamente para o uso responsável e crítico dessas ferramentas no ambiente corporativo, instituindo a cultura da verificação e a consciência sobre as graves consequências da disseminação de inverdades. O desafio reside em canalizar essa fluência digital para uma aplicação ética e criteriosa.

Nesse cenário de potenciais ruídos e distorções, a área de Comunicação Interna (CI) emerge não como um mero canal, mas como um pilar estratégico na defesa contra a desinformação que circula portas adentro. Reconhece-se que uma informação falsa que ganha tração nos corredores da empresa pode ser tão ou mais corrosiva que um ataque externo à reputação. Os riscos específicos que a CI enfrenta são tangíveis e diretos: desde a disseminação de boatos desestabilizadores sobre demissões, mudanças de rumo ou resultados financeiros, até o uso indevido das próprias ferramentas de IA por colaboradores para gerar conteúdos internos falsos ou satíricos que minam a confiança.

Em resumo, tudo isso converge para um cenário de descrédito nos canais oficiais e impacta negativamente a cultura organizacional, o engajamento e, em última instância, a própria produtividade.

Boas Práticas para a Comunicação Interna:

Reforçar canais oficiais: deixar claro quais são as fontes confiáveis de informação da empresa.

Política de uso de IA para comunicação: definir se e como a IA pode ser usada para gerar comunicados, imagens ou outros materiais internos, e quais as aprovações necessárias.

Protocolos de verificação rápida: estabelecer um fluxo ágil para checar informações suspeitas que comecem a circular internamente.

Transparência na rotulagem: se a CI utilizar IA para criar algum conteúdo (ex: ilustrações), considerar rotular de forma clara, explicando o porquê da escolha.

Educação contínua: promover workshops e materiais sobre media literacy e identificação de deepfakes e desinformação para todos os colaboradores.

Cultura de pensamento crítico: incentivar os funcionários a questionarem e verificarem informações antes de compartilharem, mesmo internamente. Fomentar o “se parece bom (ou ruim) demais para ser verdade, provavelmente é”.

Plano de resposta a crises de desinformação interna: ter um plano pré-definido para agir rapidamente caso uma informação falsa ganhe força.

A IA é, sem dúvida, uma força transformadora com potencial imenso para o bem nos negócios. Contudo, o caso da “pizza fake” ilustra perfeitamente o seu lado sombrio. Ignorar o potencial da IA para gerar desinformação não é uma opção. As empresas, lideradas por gestores conscientes e apoiadas por áreas estratégicas como a Comunicação Interna, precisam abraçar a tecnologia com entusiasmo, mas também com uma dose saudável de ceticismo, ética e, acima de tudo, um compromisso real com a veracidade.

A construção de uma cultura organizacional resiliente à desinformação é o novo imperativo na Era da Inteligência Artificial. As empresas não podem mais se dar ao luxo de serem passivas em relação a este risco. É essencial e urgente que as organizações construam um ambiente interno (uma cultura) onde os funcionários estejam conscientes, preparados e capacitados para identificar, questionar e combater informações falsas.

Essa cultura resiliente envolve educar as pessoas, estabelecer processos claros de verificação, promover o pensamento crítico, garantir a transparência na comunicação e ter planos de resposta. Não fazer isso na era da IA é deixar a organização extremamente vulnerável a danos reputacionais, financeiros, operacionais e de confiança. Dentro disto, proteger a organização contra a desinformação deixou de ser apenas uma tarefa da Comunicação ou da TI; tornou-se uma responsabilidade cultural central e um fator crítico de sucesso na Era da IA.

Caso contrário, corremos o risco de criarmos — e vivermos — em metaversos indetectáveis.

Já pensou sobre isso?

Agora me fala, gostou deste artigo? Como a sua empresa está lidando com a questão da IA?

Abraço e até a próxima news!

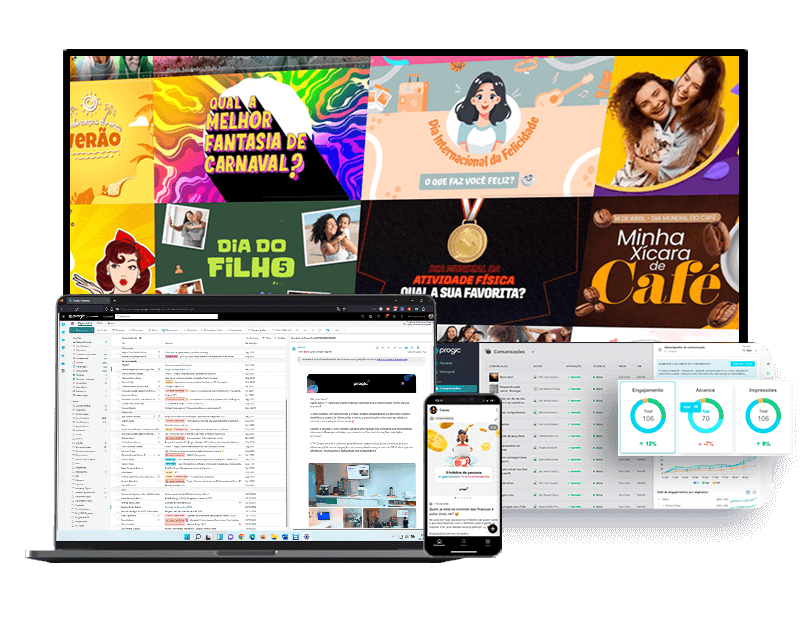

Conheça a Plataforma de Comunicação da Progic

Uma comunicação efetiva é o diferencial para ter colaboradores alinhados ao negócio e engajados em gerar resultados.

Estamos transformando a comunicação nas empresas com a mais completa e avançada Plataforma Multicanal de Comunicação Interna do Brasil, com TV, Aplicativo, E-mail e Pop-up Desktop.

Visite nosso site e veja como você também pode potencializar a Comunicação Interna da sua empresa com a Progic!